🎯 En Résumé – Points Clés

- ✅ Le 1er août 2026 est dans 6 mois - le compte à rebours de la conformité est critique

- ✅ Sanctions pouvant atteindre 35 M€ ou 7 % du chiffre d'affaires mondial déjà en vigueur depuis août 2025

- ✅ Interdictions de février 2025 désormais appliquées - désactivez les systèmes interdits

- ✅ Modèles de Surveillance Post-Marché exigibles depuis le 1er février 2026

- ✅ Systèmes de Management de la Qualité (SMQ) obligatoires pour l'IA à haut risque

- ✅ Même en cas de report des échéances, gouvernance IA = confiance des entreprises = accès au marché

👥 À Qui S'Adresse Cet Article :

- L'Échéance 2026 : Pourquoi le Compte à Rebours a Déjà Commencé

- Classification des Risques : Quels Systèmes Sont Réglementés ?

- Application Régionale : France, Allemagne, Italie, Pays-Bas

- Conformité Sectorielle : Analyses Approfondies

- Documentation Technique et Transparence

- Gouvernance : Le Bureau de l'IA et le Comité Scientifique

- Le Coût de la Non-Conformité : Sanctions et Amendes

- Votre Plan d'Action : Vers une IA de Confiance

- 5 Erreurs Critiques des Entreprises

1️⃣ L'Échéance 2026 : Pourquoi le Compte à Rebours a Déjà Commencé

#EUAIAct #ÉchéanceConformité #IAEntreprise

Le paysage réglementaire de l'IA dans l'Union européenne a radicalement changé. Depuis l'entrée en vigueur du EU AI Act le 1er août 2024, les entreprises se trouvent dans un sprint critique de 6 mois avant l'échéance d'applicabilité générale du 1er août 2026.

⚠️ Contexte Critique :

Nous sommes en février 2026. Le compte à rebours de la conformité n'est pas théorique - il se déroule maintenant.

Le Calendrier de Transition Progressif

Le EU AI Act ne s'applique pas en une seule fois. Il repose sur une mise en œuvre progressive, ce qui signifie que certains chapitres sont devenus exécutoires bien avant l'échéance générale de 2026.

| Date | Chapitres/Articles | Portée | Statut |

|---|---|---|---|

| 1er fév. 2025 | Chapitres I et II (Art. 1–5) | Définitions générales et Interdictions | ✅ EN VIGUEUR |

| 1er août 2025 | Chapitres III (Sec. 4), V, VII ; Art. 99–100 | Organismes notifiés, Règles GPAI, Gouvernance, Sanctions | ✅ EN VIGUEUR |

| 1er fév. 2026 | Législation secondaire | Échéance du modèle de Surveillance Post-Marché | ⚠️ IL Y A 4 JOURS |

| 1er août 2026 | Applicabilité générale | ÉCHÉANCE PRINCIPALE – La plupart des dispositions de l'AI Act | ⚠️ DANS 6 MOIS |

| 1er août 2027 | Art. 6(1), Annexe I | Systèmes à haut risque relevant de la législation d'harmonisation existante de l'Union | Dans 18 mois |

| 1er août 2030 | Article 111 | Autorités publiques et systèmes informatiques à grande échelle | Calendrier étendu |

⏰ Point Essentiel :

Les entreprises doivent commencer l'audit de leurs systèmes immédiatement - en particulier ceux susceptibles de relever des catégories interdites nécessitant un démantèlement depuis février 2025 (déjà passé) ou ceux exigeant la mise en place d'un SMQ d'ici août 2026 (dans 6 mois).

💡 Au-Delà de la Conformité Réglementaire :

Même si l'échéance d'août 2026 était reportée (ce qui est très improbable), la gouvernance, la transparence et la responsabilité en matière d'IA sont désormais des exigences permanentes pour les entreprises. Vos clients, partenaires, assureurs et régulateurs l'exigent dès aujourd'hui, indépendamment des échéances légales.

2️⃣ Classification des Risques : Quels Systèmes Sont Réglementés ?

#ÉvaluationDesRisques #IAHautRisque #PratiquesInterdites

L'AI Act adopte une approche fondée sur les risques, soumettant les systèmes à des exigences proportionnelles à leur dangerosité potentielle.

🔴 Risque Inacceptable (Pratiques Interdites)

Depuis le 1er février 2025 (déjà en vigueur), les pratiques listées à l'Article 5 doivent être abandonnées :

- ❌ Techniques Subliminales : IA manipulant le comportement au-delà de la conscience

- ❌ Systèmes Exploitants : Ciblant les vulnérabilités (âge, handicap)

- ❌ Scoring Social : Classification par les autorités publiques basée sur le comportement social

- ❌ Identification Biométrique « en temps réel » : Identification à distance dans les espaces publics par les forces de l'ordre (exceptions strictes)

Sanction : Jusqu'à 35 millions d'euros OU 7 % du chiffre d'affaires annuel mondial, le montant le plus élevé prévalant

🟠 Systèmes d'IA à Haut Risque (Annexe III)

Les systèmes utilisés dans des secteurs critiques doivent se conformer à des obligations rigoureuses :

Secteurs :

- 💼 Emploi et RH : Recrutement, évaluation des performances, décisions de promotion

- 💰 Scoring de Crédit : Évaluation de la solvabilité, décisions de prêt

- 🏥 Santé : Diagnostic médical, recommandations de traitement

- 🎓 Éducation : Évaluation des étudiants, décisions d'admission

- 🏗️ Infrastructures Critiques : Énergie, transports, approvisionnement en eau

- ⚖️ Forces de l'Ordre : Police prédictive, évaluation des risques

- 🛂 Immigration et Contrôle aux Frontières : Décisions de visa, demandes d'asile

Exigences :

- ✅ Système de Management de la Qualité (SMQ)

- ✅ Documentation technique (Annexe IV)

- ✅ Surveillance Post-Marché (SPM)

- ✅ Mécanismes de contrôle humain

- ✅ Transparence et explicabilité

- ✅ Procédures de gestion des risques

Sanction : Jusqu'à 15 M€ OU 3 % du chiffre d'affaires mondial

🟡 Intelligence Artificielle à Usage Général (GPAI) et Systèmes Existants

Les modèles GPAI (ex. : modèles de langage de grande taille comme GPT, Claude, Gemini) sont soumis à des règles spécifiques de transparence et de documentation technique en vigueur depuis le 1er août 2025.

Dispositions Transitoires :

- • Les modèles GPAI commercialisés avant le 1er août 2025 ont jusqu'au 1er août 2027 pour se conformer

- • Les systèmes d'IA dans les systèmes informatiques à grande échelle (Annexe X) mis en place avant août 2027 bénéficient d'un délai prolongé jusqu'au 1er août 2030

3️⃣ Application Régionale : France, Allemagne, Italie, Pays-Bas

#ApplicationNationale #RéglementationLocale #ÉtatsMembresUE

Bien que l'AI Act s'applique à l'ensemble de l'UE, les autorités de surveillance nationales et les priorités d'application varient considérablement.

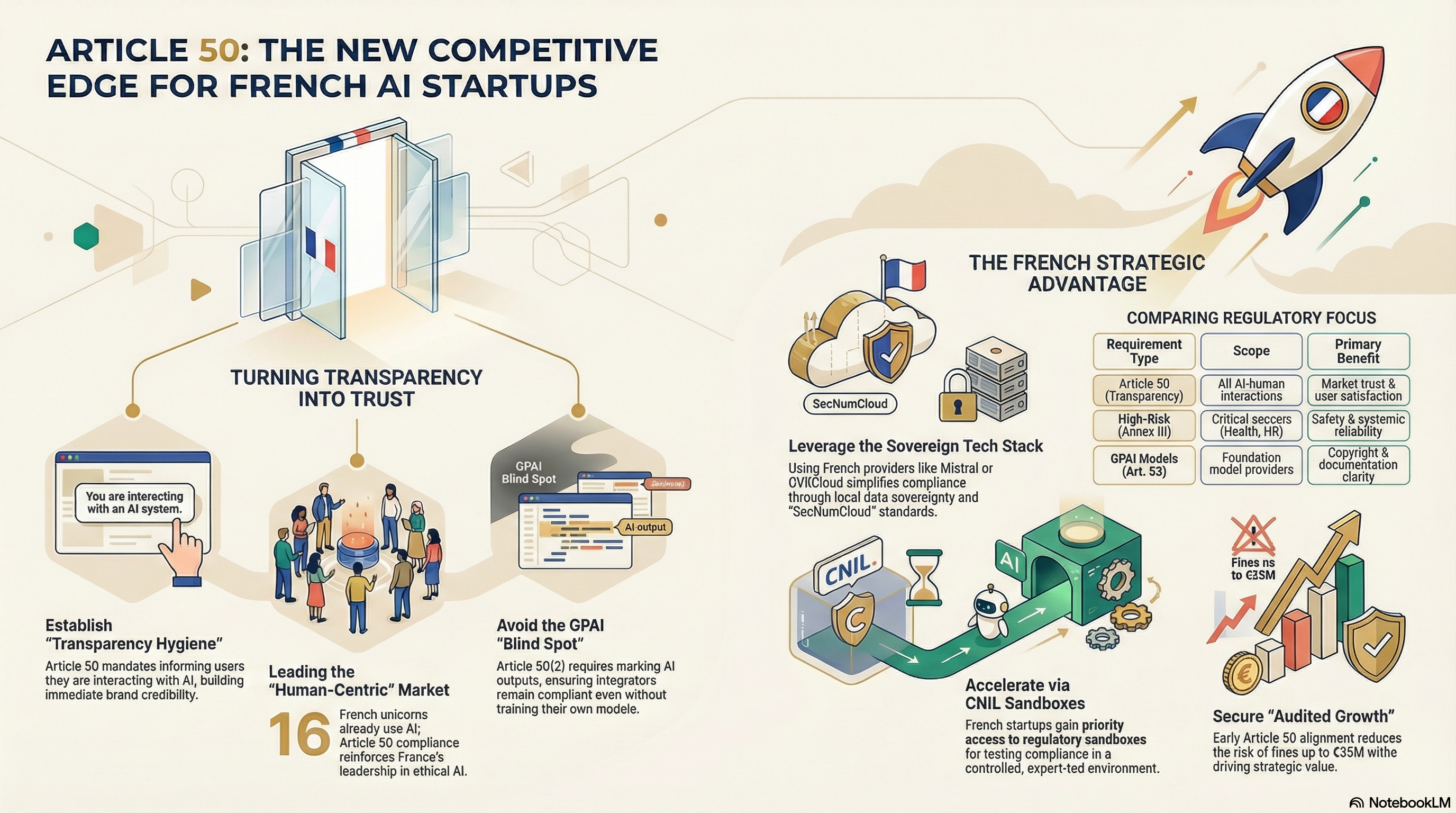

🇫🇷 France

Autorités de Surveillance :

- • CNIL (Protection des Données et Vie Privée)

- • INESIA (Institut National d'Évaluation et de Sécurité de l'IA) - créé en 2025

Priorités d'Application :

- • Politique de souveraineté numérique

- • Investissement de 2,5 milliards d'euros dans l'industrie de l'IA

- • Sécurité et défense nationale

Orientations Spécifiques :

- • Guides de la CNIL pour les « caméras augmentées par l'IA »

- • Recommandations pour le déploiement de l'IA générative

- • Accent sur l'hébergement européen (SecNumCloud)

Avantage Stratégique : Les entreprises basées à Paris bénéficient d'un accès direct à l'INESIA pour un accompagnement de conformité localisé

🇩🇪 Allemagne

Autorités de Surveillance :

- • Bundesnetzagentur (Agence fédérale des réseaux) - surveillance générale

- • BaFin - secteur financier

Priorités d'Application :

- • Droits de codétermination des salariés sur le lieu de travail

- • Implication du comité d'entreprise dans le déploiement de l'IA

💡 Conseil Pratique : Les employeurs peuvent mettre en place des barrières techniques empêchant l'accès aux prompts des utilisateurs, évitant ainsi certains déclencheurs de codétermination

🇮🇹 Italie

Autorité de Surveillance :

- • IDPA (Autorité italienne de protection des données)

Priorités d'Application :

- • Régulateur le plus agressif de l'UE

- • Vérification de l'âge pour protéger les mineurs

- • Amendes historiques : OpenAI (15 M€ initialement), Replika/Luka Inc. (5 M€)

Orientations Spécifiques :

- • Stratégie nationale IA (2024–2026) axée sur le capital humain

- • Contrôle renforcé de l'IA destinée au grand public

🇳🇱 Pays-Bas

Autorité de Surveillance :

- • Autoriteit Persoonsgegevens (AP) (Autorité néerlandaise de protection des données)

Priorités d'Application :

- • Grande sensibilité au profilage algorithmique

- • Vigilance post-scandale de l'administration fiscale (détection de fraude ayant causé des préjudices financiers)

Orientations Spécifiques :

- • Principes de « non-discrimination dès la conception »

- • E-learning pour les algorithmes gouvernementaux

4️⃣ Conformité Sectorielle : Analyses Approfondies

#ConformitéSectorielle #ServiceFinanciers #ConformitéRH #Santé

💰 Services Financiers

L'IA utilisée dans les contrôles internes ou les services d'investissement doit être supervisée par du personnel qualifié.

Exigences Clés :

- • Cadres de responsabilité algorithmique

- • Prévention des biais dans les modèles prédictifs de risque de crédit

- • Harmonisation avec les exigences MiFID II

Autorités :

BaFin en Allemagne, AMF en France

⚠️ L'IA financière est généralement classée à haut risque au titre de l'Annexe III

💼 Ressources Humaines et Emploi

L'IA utilisée pour le recrutement ou l'évaluation des collaborateurs est généralement classée à Haut Risque.

Exigences Obligatoires :

- ✅ Transparence : Informer les candidats de l'utilisation de l'IA

- ✅ Contrôle humain : Aucune décision de rejet entièrement automatisée

- ✅ Non-discrimination : Conformité avec la loi générale sur l'égalité de traitement (Allemagne), le Code du travail (France)

- ✅ Explicabilité : Les candidats doivent comprendre les facteurs de décision

Violations Courantes :

- • Tri automatisé de CV sans examen humain

- • Biais dans les algorithmes de classement des candidats

- • Manque de transparence dans les évaluations assistées par IA

🏥 Santé / Dispositifs Médicaux

Les dispositifs médicaux intégrant l'IA sont soumis à une double conformité : EU AI Act + Règlement relatif aux Dispositifs Médicaux (MDR) 2017/745

Exigences Supplémentaires :

- • Validation clinique et tests de sécurité

- • Surveillance post-marché (plus stricte que la SPM standard)

- • Signalement des incidents aux autorités IA et aux régulateurs de dispositifs médicaux

Bacs à Sable Réglementaires :

- • L'UE encourage les tests en environnement contrôlé

- • Remarque : le programme « AI Airlock » de la MHRA britannique est distinct (le Royaume-Uni est un pays tiers)

5️⃣ Documentation Technique et Transparence : Le Socle de la Conformité

#DocumentationTechnique #AnnexeIV #Article50

La conformité des systèmes à haut risque repose sur l'Annexe IV (Documentation Technique) et l'Article 50 (Transparence).

Exigences Essentielles de l'Annexe IV

Doit Inclure :

- 📋 Description du Système : Architecture, spécifications de conception, finalité prévue

- 📋 Données d'Entraînement : Spécifications, jeux de données de validation, gouvernance des données

- 📋 Gestion des Risques : Procédures d'évaluation, mesures d'atténuation

- 📋 Contrôle Humain : Mécanismes, responsabilités, voies d'escalade

- 📋 Indicateurs de Performance : Précision, robustesse, mesures de cybersécurité

- 📋 Preuves de Conformité : Dossiers d'évaluation de la conformité

⚠️ Échéance Critique :

1er février 2026 – La Commission a publié le modèle de Surveillance Post-Marché

Exigences de Transparence de l'Article 50

Contenus Générés par l'IA (Deepfakes) :

- ✅ Étiquetage clair comme contenu généré artificiellement

- ✅ Indicateurs lisibles par machine

- ✅ Capacité du public à distinguer le contenu authentique

Interaction avec un Système d'IA :

- ✅ Les utilisateurs doivent savoir qu'ils interagissent avec une IA (chatbots, assistants virtuels)

- ✅ Exception : contexte évident où l'utilisation de l'IA est manifeste

Check-list du Système de Management de la Qualité (SMQ)

Composantes Essentielles :

- Stratégie de conformité réglementaire

- Procédures de gestion des données (incluant les tests de biais)

- Cadre de gestion des risques

- Protocoles de contrôle humain

- Plan de surveillance post-marché

- Procédures de signalement des incidents

- Maintenance de la documentation technique

- Audits et mises à jour réguliers

💡 Considération pour les PME :

La Commission fournit des formulaires de documentation simplifiés pour les micro et petites entreprises afin de réduire la charge administrative

6️⃣ Gouvernance : Le Bureau de l'IA et le Comité Scientifique

#BureauIA #GouvernanceUE #ComitéScientifique

Le EU AI Act établit une hiérarchie de gouvernance complexe avec des dynamiques de pouvoir notables.

Le Bureau de l'IA (AI Office)

Localisation : Commission européenne

Rôle : Supervision centrale, contrôle des GPAI, coordination de l'application

Pouvoirs Clés :

- • Évaluation des modèles GPAI

- • Évaluation des risques systémiques

- • Élaboration de Codes de Bonnes Pratiques

- • Coordination de l'application transfrontalière

Comité Scientifique d'Experts Indépendants

Rôle :

- • Évaluer les modèles GPAI

- • Émettre des « alertes qualifiées » concernant les risques systémiques

- • Fournir des orientations techniques au Bureau de l'IA

Composition : Experts indépendants en sécurité et éthique de l'IA

La « Confusion Juridique » (Analyse de Kai Zenner)

Point Essentiel : Les pouvoirs du Bureau de l'IA ont été considérablement étendus au-delà de l'accord politique initial, diluant de fait l'influence du Comité IA (représentant les États membres).

Impact : Les États membres ont perdu des compétences significatives en matière de mise en œuvre et d'application, le Bureau de l'IA ayant remplacé le Comité dans différents chapitres.

7️⃣ Le Coût de la Non-Conformité : Sanctions et Amendes

#SanctionsAIAct #Amendes #RisqueRéglementaire

Les risques financiers liés à la non-conformité sont considérables, dépassant même les sanctions du RGPD.

Barème des Sanctions (Articles 99 et 101)

| Type de Violation | Amende Maximale | Statut |

|---|---|---|

| Pratiques Interdites (Art. 5) | 35 M€ OU 7 % du chiffre d'affaires mondial | ✅ En vigueur depuis août 2025 |

| Non-conformité Haut Risque | 15 M€ OU 3 % du chiffre d'affaires mondial | ✅ En vigueur depuis août 2025 |

| Informations Incorrectes | 7,5 M€ OU 1 % du chiffre d'affaires mondial | ✅ En vigueur depuis août 2025 |

| Violations GPAI | 15 M€ OU 3 % du chiffre d'affaires mondial | ✅ En vigueur depuis août 2025 |

⚠️ C'est toujours le montant le PLUS ÉLEVÉ qui s'applique (contrairement aux PME, pour lesquelles c'est le montant le plus bas)

Exemples Historiques d'Application

🇮🇹 La Position Offensive de l'Italie :

- • OpenAI : Amende de 15 M€ (initialement, puis renégociée)

- • Luka Inc. (Replika) : Amende de 5 M€

🇳🇱 Pays-Bas :

- • Administration fiscale : Amende de 2,75 M€ (scandale de discrimination algorithmique)

Au-Delà des Sanctions Financières

Exclusion du Marché :

- • Retrait des systèmes non conformes du marché européen

- • Perte de contrats exigeant une certification de conformité

Atteinte à la Réputation :

- • Actions d'application publiques

- • Atteinte à l'image de marque et désavantage concurrentiel

- • Perte de confiance des parties prenantes

Recours Individuels :

- • Réclamations pour « atteintes graves à la vie privée »

- • Actions en justice pour profilage algorithmique discriminatoire

- • Possibilité de recours collectifs

Effets de Cascade Réglementaire :

- • Les violations de l'AI Act déclenchent des enquêtes RGPD

- • Exposition réglementaire cumulée

Même en cas de report des échéances, les conséquences commerciales sont permanentes : les entreprises exigent la conformité dans leurs appels d'offres, les assureurs ajustent leurs primes en fonction de la maturité de la gouvernance, et les investisseurs exigent des preuves d'IA responsable lors de la due diligence.

8️⃣ Votre Plan d'Action : Vers une IA de Confiance

#PlanDAction #FeuilleDeRoute #IADeConfiance

Le chemin vers août 2026 exige un engagement envers les Valeurs de Gestion Responsable des Données : équité, transparence et responsabilité.

Actions Immédiates (30 Prochains Jours)

1️⃣ Audit d'Urgence

- ✅ Examiner tous les systèmes d'IA au regard des pratiques interdites de l'Article 5

- ✅ Vérifier qu'aucun système interdit n'est encore en fonctionnement (l'échéance de février 2025 est passée)

- ✅ Classifier tous les systèmes : Interdit, Haut Risque, Risque Limité, Risque Minimal

2️⃣ Préparation de la Surveillance Post-Marché

- ✅ Examiner le modèle SPM du 1er février 2026

- ✅ Mettre en place l'infrastructure de surveillance

- ✅ Définir les procédures de signalement des incidents

3️⃣ Structure de Gouvernance

- ✅ Nommer un Responsable Conformité IA

- ✅ Créer un comité de gouvernance IA transversal

- ✅ Définir les rôles et responsabilités (matrice RACI)

Actions à Moyen Terme (60 à 180 Jours)

4️⃣ Documentation Technique (Annexe IV)

- • Constituer une documentation complète pour tous les systèmes à haut risque

- • Mettre en place le contrôle de version et les procédures de mise à jour

- • Préparer les évaluations de conformité

5️⃣ Système de Management de la Qualité

- • Concevoir un SMQ aligné sur le cadre ISO 42001 AIMS

- • Mettre en œuvre les procédures de tests de biais et de validation

- • Établir les mécanismes de contrôle humain

6️⃣ Utiliser les Bacs à Sable Réglementaires

- • Collaborer avec les autorités nationales compétentes (INESIA en France, Bundesnetzagentur en Allemagne)

- • Tester les systèmes innovants avant leur déploiement complet

- • Obtenir un retour anticipé sur votre approche de conformité

Actions Stratégiques (D'ici Août 2026)

7️⃣ Codes de Bonnes Pratiques

- • Participer à l'élaboration du code GPAI au niveau de l'Union

- • Contribuer aux normes de transparence de l'Article 50

- • Développer votre réseau avec les acteurs du secteur

8️⃣ Certification par des Tiers

- • Faire appel à des organismes d'évaluation de la conformité

- • Obtenir la certification ISO 42001

- • Mettre en place un système de conformité certifié Daiki

9️⃣ Programme de Formation Entreprise

- • Culture IA pour l'ensemble du personnel (exigence de l'Article 4)

- • Formation spécialisée pour les opérateurs d'IA

- • Mises à jour régulières sur la conformité

🚨 5 Erreurs Critiques des Entreprises

#ErreursConformité #ÉvitezCesPièges #BonnesPratiques

❌ Considérer août 2026 comme le point de départ

✅ Les sanctions sont en vigueur depuis août 2025 ; les interdictions depuis février 2025

❌ Supposer que la conformité au RGPD couvre l'AI Act

✅ Réglementations complémentaires mais distinctes ; l'Annexe IV et les exigences SMQ sont nouvelles

❌ Ignorer les exigences sectorielles spécifiques

✅ Les secteurs RH, finance et santé ont des obligations supplémentaires au-delà du texte de base

❌ Sous-estimer la charge documentaire

✅ L'Annexe IV exige des dossiers techniques exhaustifs ; commencez dès maintenant

❌ Attendre une clarté réglementaire parfaite

✅ Les Codes de Bonnes Pratiques évoluent ; agissez sur la base des orientations actuelles, adaptez ensuite

🎯 Transformez les Exigences Réglementaires en Avantage Concurrentiel

#AvantageConcurrentiel #IADeConfiance #LeadershipEntreprise

À 6 mois de l'échéance d'août 2026 et avec des sanctions déjà en vigueur, la fenêtre de préparation stratégique se referme.

Vision stratégique : Même en cas de report de l'échéance d'août 2026, la gouvernance de l'IA est désormais une exigence permanente du marché. Vos clients, partenaires, assureurs et régulateurs l'exigent dès aujourd'hui.

Le Dividende de la Confiance – Une conformité anticipée génère :

- ✅ Avantage dans les Marchés Publics : Remportez les appels d'offres exigeant la certification AI Act

- ✅ Avantages Assurantiels : Primes réduites pour une gouvernance mature démontrée

- ✅ Accès aux Partenariats : Les clients grands comptes exigent la conformité de leurs fournisseurs

- ✅ Confiance des Investisseurs : Signal positif lors de la due diligence

- ✅ Leadership de Marque : Positionnement « IA de Confiance » sur le marché

En donnant la priorité au contrôle humain et à la documentation technique dès aujourd'hui, les entreprises transforment les exigences réglementaires en avantages concurrentiels fondés sur la confiance.

🆓 Commencez par un Audit Flash Gratuit

Obtenez le score de préparation de votre entreprise à la conformité EU AI Act en 10 minutes :

- ✅ Classification des systèmes et évaluation des risques

- ✅ Analyse des écarts de documentation Annexe IV

- ✅ Évaluation du cadre SMQ

- ✅ Feuille de route prioritaire avec échéancier

- ✅ Score de préparation pour août 2026

💼 Ou Réservez une Consultation Entreprise

Évaluation complète de la préparation avec Certificat de Conformité Daiki pour les entreprises.

Ce que Nous Livrons :

- • Audit complet des systèmes et classification des risques

- • Cadre de documentation technique Annexe IV

- • Implémentation ISO 42001 AIMS

- • Conception du système de Surveillance Post-Marché

- • Feuille de route de conformité sur 12 mois

- • Présentation exécutive pour le conseil d'administration